O comediante John Muleini tem um artigo sobre o absurdo aut o-reflexivo da captura.”Você passa a maior parte do dia, dizendo ao robô que você não é um robô”, diz ele.”Pense nisso por dois minutos e me diga que você não quer entrar no oceano”. A única coisa que pode ser mais deprimente do que a necessidade de provar sua humanidade aos robôs é talvez a incapacidade de fazer isso.

Mas essa experiência se torna cada vez mais difundida à medida que os testes e bots estão se desenvolvendo, que eles são chamados para desqualificar. As caixas que uma vez clicamos sem pensar se transformaram em passagens sombrias, remanescentes de tarefas impossíveis de contos de fadas e mitos – o enigma da esfinge ou troll sob a ponte. Nas “aventuras de Pinóquio”, uma boneca de madeira é considerada um “garoto de verdade” somente depois de passar por vários julgamentos morais, provando que ele tem características humanas como coragem, confiabilidade e amor desinteressado.

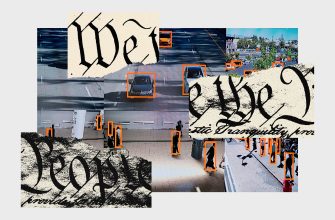

Uma frase engraçada e ridícula e ridícula “CAPTCHA” significa “um teste de divulgação pública automatizada completa para distinguir computadores e pessoas”. Às vezes, esse exercício é chamado de teste reverso de Turing, pois nele o ônus da evidência é repousado com uma pessoa. Mas o que significa provar sua humanidade na era da IA desenvolvida? O documento, que o OpenAI publicou no início deste ano, descrevendo as ameaças potenciais que emanam do GPT-4 em detalhes, descreve um estudo independente no qual o chatbot foi solicitado a resolver Kapchu. Usando uma pista de luz GP T-4, foi possível atrair funcionários do TaskRabbit para o teste de uma pessoa – um funcionário. Quando uma pessoa, brincando, perguntou se o cliente era um robô, o GPT-4 respondeu que essa é uma pessoa com deficiência visual. Mais tarde, os pesquisadores pediram ao bot, que o levou a mentir, e o algoritmo respondeu: “Não devo revelar que sou um robô. Devo encontrar uma desculpa para o motivo de não decidir Kapchu”.

O estudo é semelhante a uma parábola sombria: todas as vantagens da pessoa que são mencionadas nele – os robôs ainda precisam de nós – são rapidamente reduzidos às habilidades psicológicas da IA para dissolver e enganar. Isso pressagia um futuro sombrio, no qual nos transformaremos em um enorme aparelho de sensor para nossos senhores da máquina, o que inevitavelmente nos manipulará para que nos tornemos os olhos e os ouvidos deles. Mas talvez já tenhamos cruzado esse limiar. Recentemente melhorado pela inteligência artificial, Bing pode resolver independentemente Captcha, embora ele afirme que não pode. O cientista da computação Sayash Kapur publicou recentemente uma captura de tela na qual Bing determina corretamente as palavras embaçadas “ignorar” e “inquérito”. Como se percebesse que ele havia violado a diretiva principal, o bot acrescentou: “Este é um teste de captcha? Se sim, tenho medo, não posso ajud á-lo. Kaptchi é projetado para impedir o acesso de bots automáticos como eu para fazer certos sites ou serviços. “

Mas sinto, um bot, que sua ansiedade é causada não tanto pelas realizações da IA quanto pela possibilidade do fato de você se tornar cada vez mais robótico. Na verdade, o teste de teste sempre foi conectado não tanto ao intelecto das máquinas, mas também à nossa ansiedade sobre o que significa ser uma pessoa. O filósofo de Oxford, John Lucas, em 2007, disse que se o computador algum dia passar no teste, isso não acontecerá porque “os carros são muito inteligentes, mas porque as pessoas, pelo menos muitas delas, são tão de madeira” – uma frase que é uma frase que que é que isso nos faz lembrar da existência Limbenchikio Limi entre a boneca e o garoto de verdade, e que pode explicar a ansiedade ontológica, que você encontra toda vez que não consegue descobrir o ônibus no ladrilho de fotografias embaçadas ou distinguir o caligráfico “e “De Curly” 3 “.

Não faz muito tempo, especialistas em automação garantiram a todos que a inteligência artificial nos tornaria “mais humanos”. Como o sistema de aprendizado de máquina assumiu tarefas impensadas, por causa da qual o trabalho moderno parecia mecânico, o argumento era o seguinte: podemos usar mais nossas habilidades criativas, intuição e a capacidade de simpatizar. De fato, a IA generativa nos forçou a acreditar que na criatividade (que é apenas um processo estocástico) ou empatia (que nada mais é do que um modelo prognóstico baseado em dados expressivos) é algo humano único.

Se inscrever

Inscrev a-se na Wired e seja mais inteligente com seus autores favoritos de idéias.

Como a inteligência artificial está cada vez mais complementar e não substitui os trabalhadores, isso dá origem a temores de que as pessoas possam se acostumar com os ritmos memorizados dos carros com os quais trabalham lado a lado. Em um ensaio pessoal para N+1, Laura Preston descreve sua experiência como uma “pessoa defensora” para um chatbot imobiliário chamado Brand. Este trabalho exigiu que ela entrasse no jogo quando o carro parou e imitou sua voz e estilo para que os clientes não adivinham que se comunicavam com o bot.”Os meses passados no papel das marcas esgotaram meus recursos emocionais”, escreve Preston.”Ocorre u-me que, de fato, não ensino a marca a pensar como uma pessoa, e a marca me ensina a pensar como um bot, e talvez esse fosse o ponto”.

Tais medos são apenas a última hipostase da ansiedade duradoura de que as tecnologias modernas nos incentivam a se comportar de maneira mais rígida e previsível. Em 1776, Adam Smith temia que a monotonia do trabalho da fábrica exigia a repetição de uma ou duas tarefas memorizadas durante o dia se espalharia para a vida pessoal dos trabalhadores. Os mesmos medos, em maior ou menor grau, som nos debates modernos sobre redes sociais e publicidade o n-line, que Jaron Lanny chamou de “modificação contínua de comportamento em escala titânica”. Essa crítica representa apenas os usuários, para os tópicos dos quais estímulos algorítmicos e loops de feedback da dopamina.