Os sistemas automatizados estão cada vez mais tomando decisões no local de trabalho. Veja como conter os possíveis danos e abusos.

Salve esta história

Salve esta história

Esper a-se que este mês a União Europeia conclua o desenvolvimento de uma diretiva sobre o trabalho nas plataformas – uma nova lei que regula a operação de plataformas digitais. Esta é a primeira lei proposta no nível da União Europeia, que regula claramente a “gestão algorítmica”: o uso de sistemas de monitoramento automatizados, avaliação e tomada de decisão para tomar ou justificar decisões, incluindo seleção, contratação, distribuição de tarefas e demissão.

Opinion Wired

Sobre o site

Icelinn Kelly Lit, e x-pesquisador do Instituto de Direitos Humanos da Universidade de Oxford, trabalha no escritório de Blackstone Chambers em Londres.

M. Six Zilberman e Halef Abrah – Guardas pó s-core do Instituto de Direitos Humanos Bonavero Oxford University.

Jeremias Adam s-Prassl é professor de direito na Faculdade de Magdalen Oxford University e pesquisado r-chefe do Projeto Imanage para regular a gestão algorítmica financiada pelo Conselho Europeu de Pesquisa (ERC).

No entanto, o escopo da diretiva sobre o trabalho nas plataformas é limitado por plataformas de mã o-d e-obra digital, ou seja, “Trabalhe nas plataformas”. E embora o gerenciamento algorítmico pela primeira vez tenha se espalhado nas plataformas de trabalho da Economia de Gig, nos últimos anos – contra o pano de fundo da pandemia – a tecnologia e a prática da gestão algorítmica começaram a se espalhar rapidamente na estrutura das relações de trabalho tradicionais .

Algumas das publicações mais comumente controladas, prejudiciais e amplas do uso de algoritmos foram associadas ao trabalho em armazéns e em call centers. Trabalhadores de armazéns, por exemplo, relataram que as cotas são tão difíceis que não tiveram tempo de ir ao banheiro e disseram que foram demitidas de acordo com o algoritmo por não cumpr i-los. O gerenciamento algorítmico também foi documentado no comércio e produção de varejo, no desenvolvimento de software, marketing e consultoria, bem como no trabalho do setor público, incluindo assistência médica e proteção de ordem.

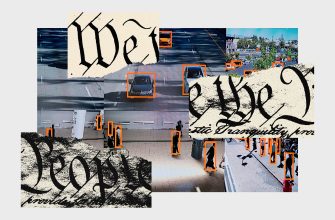

Os especialistas em gerenciamento de pessoal geralmente chamam esses métodos algorítmicos de gerenciar a “análise das pessoas”. Mas alguns observadores e pesquisadores criaram um nome mais preciso para monitorar o software instalado em computadores e números de telefone nos quais geralmente depende: “Bossware”. Ele acrescentou um novo nível de vigilância à vida profissional: rastreando a localização, o registro de prensas de chaves, capturas de tela das telas dos trabalhadores e até, em alguns casos, vídeo e fotos tiradas através de webcams nos computadores de funcionários.

Como resultado, entre pesquisadores e políticos, a posição parecia que as diretrizes sobre como trabalhar nas plataformas não são suficientes e que a União Europeia também deveria desenvolver uma diretiva que regula especialmente a gestão algorítmica no contexto do emprego tradicional.

É fácil entender por que as organizações tradicionais usam o gerenciamento algorítmico. As vantagens mais óbvias estão associadas ao aumento da velocidade e escala do processamento de informações. Por exemplo, ao selecionar e contratar pessoal da empresa, milhares de aplicativos para uma vaga aberta podem receber. O software de resumo e outras ferramentas automatizadas podem ajudar a classificar essa enorme quantidade de informações. Em alguns casos, o gerenciamento algorítmico pode ajudar a aumentar a eficiência da organização, por exemplo, devido a uma seleção mais razoável de funcionários para trabalhar. Existem algum potencial, mas até agora principalmente vantagens não realizadas. Com o desenvolvimento completo, o gerenciamento algorítmico pode reduzir o viés ao contratar, avaliar e promover ou melhorar o poço dos funcionários, identificando as necessidades de treinamento ou apoio.

Mas há danos e riscos óbvios – tanto para funcionários quanto para organizações. Os sistemas nem sempre são muito bons e às vezes tomam decisões claramente errôneas ou discriminatórias. Eles exigem uma grande quantidade de dados, o que significa que geralmente se tornam o motivo do novo monitoramento generalizado e próximo dos funcionários, e geralmente são desenvolvidos e implementados com uma participação relativamente pequena dos funcionários. Como resultado, às vezes eles levam à adoção de decisões de gerenciamento tendenciosas ou incorretas, danificam a vida privada, sujeitam a organização de riscos no campo da regulamentação e relações públicas e também pode minar a confiança entre funcionários e gerenciamento.

A situação atual com a regulamentação da governação algorítmica na UE é complexa. Muitas peças legislativas já estão em vigor. Por exemplo, a lei de protecção de dados confere alguns direitos aos trabalhadores e candidatos a emprego, tal como os sistemas nacionais de legislação laboral, legislação sobre discriminação e legislação sobre saúde e segurança no trabalho. No entanto, alguns elementos ainda estão faltando. Por exemplo, embora a lei de protecção de dados obrigue os empregadores a garantir que os dados que detêm sobre empregados e candidatos são “precisos”, não é claro se os sistemas de tomada de decisão são obrigados a fazer inferências ou decisões razoáveis com base nesses dados. Se um prestador de serviços for demitido por causa de uma avaliação ruim do cliente, mas a avaliação foi motivada por fatores além do controle do funcionário, os dados podem ser “precisos” no sentido de que refletem a experiência insatisfatória do cliente. Portanto, uma decisão baseada neles pode ser legal, mas ainda assim irracional e inadequada.

Isto leva a um paradoxo interessante. Por um lado, é necessário reforçar a protecção. Por outro lado, muitas leis existentes criam uma complexidade desnecessária para as organizações que tentam utilizar a governação algorítmica de forma responsável. Para confundir ainda mais as coisas, as disposições de governação algorítmica contidas na nova Diretiva sobre Trabalho em Plataformas significam que os trabalhadores de plataformas, há muito tempo subprotegidos por lei, terão provavelmente mais proteção contra a monitorização intrusiva e a governação algorítmica propensa a erros do que os trabalhadores tradicionais.

Mais popular

A ciência

Uma bomba-relógio demográfica está prestes a atingir a indústria da carne bovina.

Matt Reynolds

Negócios

Dentro do complexo ultrassecreto de Mark Zuckerberg no Havaí

Guthrie Scrimgeour

Engrenagem

Primeiro, dê uma olhada no Matic, o aspirador robô redesenhado

Adriane So

Negócios

As novas alegações de Elon Musk sobre a morte de macacos estimulam novas demandas de investigação da SEC

Dhruv Mehrotra

Uma directiva mais ampla sobre governação algorítmica que também proteja os trabalhadores tradicionais faria três coisas. Primeiro, evitar violações de privacidade que resultem de uma vigilância indevidamente ampla e estreita dos trabalhadores. Em segundo lugar, limitar a medida em que a governação algorítmica aumenta as assimetrias de informação existentes entre empregadores e trabalhadores. Os empregadores já sabem mais sobre os trabalhadores no seu conjunto do que os trabalhadores sabem sobre si próprios, por exemplo, se um trabalhador recebe mais do que outro pelo mesmo trabalho. Esta lacuna de informação dá aos empregadores influência nas negociações, dando-lhes mais poder do que já possuem. A gestão algorítmica dá aos empregadores ainda mais informações sobre os trabalhadores – informações de que as empresas muitas vezes não precisam. Como afirma o relatório do governo alemão de 2022 sobre a proteção de dados no local de trabalho: “É necessário evitar que os empregadores saibam tudo sobre os seus empregados”. E em terceiro lugar, é necessário garantir que a vontade humana – especialmente, mas não apenas a vontade dos gestores – não se perca em momentos críticos da tomada de decisões no local de trabalho.

A nossa investigação no Instituto Bonavero para os Direitos Humanos de Oxford baseia-se num corpo crescente de investigação empírica realizada por jornalistas de investigação, cientistas sociais e cientistas da computação, documentando as experiências dos trabalhadores e das organizações em matéria de governação algorítmica. Concluímos que estes três objetivos podem ser alcançados através de uma combinação de quatro estratégias básicas: proibições, exigências, direitos e proteção.

Proibições. A recolha e o tratamento de dados em determinados contextos, como fora do trabalho, em áreas privadas do local de trabalho (por exemplo, casas de banho e áreas de descanso) ou em comunicações privadas, como com representantes dos trabalhadores, devem ser proibidos sem exceção. A recolha ou tratamento de quaisquer dados para efeitos de manipulação emocional ou psicológica, bem como para previsão ou persuasão contra o exercício de direitos legais, como o de uma organização, também deverá ser proibida. Por último, a rescisão automatizada de contratos de trabalho deverá ser proibida.

Essas proibições protegerão contra violações da inviolabilidade da vida privada e dos riscos de direitos fundamentais, como a organização de empregos que surgem como resultado da coleta de dados exigida pelos mais exigentes desses sistemas de gerenciamento algorítmico. Eles também ajudarão a retardar a expansão da assimetria de informação entre funcionários e empregadores, declarando certos contextos inaceitáveis para a coleta de funcionários. E a proibição de rescisão automática das relações trabalhistas garantirá a aplicação do julgamento humano no momento mais responsável e potencialmente irreversível das relações trabalhistas.

Requisitos. Os sistemas de gerenciamento algorítmico devem ser aceitáveis apenas se forem necessários para a contratação ou para um contrato de trabalho; para conformidade com obrigações legais externas; ou para proteger os interesses vitais (por exemplo, segurança) de um funcionário ou outro indivíduo. Para proteger os trabalhadores e organizações da “inteligência artificial”, a lei deve exigir que os sistemas usados sejam claramente capazes de cumprir seu objetivo. Empregadores ou fornecedores de sistemas também devem realizar e publicar avaliações detalhadas dos efeitos dos sistemas antes e regularmente após sua implantação.