Por ignorância ou pela intenção maligna, os políticos usam banalidades para regular a inteligência artificial, que podem perseguir mais cidadãos do que proteg ê-los.

Salve esta história

Salve esta história

Banco de dados de inteligência artificial →

Quando no mês passado, a Comissão da União Europeia publicou sua proposta de regular a inteligência artificial, a maioria da comunidade política americana jurou. Seus louvores foram pelo menos parcialmente justificados: os estados democráticos mais poderosos do mundo não são suficientemente regulamentados pela IA e outras novas tecnologias, e este documento se tornou uma espécie de passo adiante. No entanto, principalmente a proposta e as respostas enfatizam a retórica confusa dos países democráticos em relação à IA.

Na última década, os objetivos do regulamento da IA frequentemente contradizem propostas específicas para regulamentação em alto nível e como os estados finais devem parecer claramente formulados em ambos os casos. O progresso consistente e significativo no desenvolvimento de uma regulamentação democrática de IA atraente para a comunidade internacional, mesmo que possa variar do país para o país, começa com a eliminação de numerosas contradições e características não convincentes no discurso.

A Comissão da UE chamou sua proposta de marco na regulamentação da IA. O vice-presidente executivo de Margrette Westagger disse após sua publicação: “Acreditamos que isso é muito importante. Somos os primeiros neste planeta a oferecer uma estrutura tão legal”. Thierry Breton, outro membro da Comissão, disse que as propostas “destinadas a fortalecer as posições da Europa como o centro mundial de experiência avançada no campo da IA do laboratório para o mercado, garantindo que a IA na Europa respeite nossos valores e regras e uso do potencial de IA para uso industrial “.

Isso, é claro, é melhor do que se os governos de muitos países, especialmente os Estados Unidos, estabelecidos nas regras de trânsito para empresas, instituições governamentais e outras instituições. A IA já é amplamente utilizada na UE, apesar da supervisão e responsabilidade mínima, seja observação em Atenas ou gerenciamento de ônibus em Málaga, Espanha.

Mas se considerarmos o ato normativo da UE “avançado” apenas porque é o primeiro, isso apenas mascara muitos problemas da proposta. Um salto retórico semelhante é um dos primeiros problemas que a estratégia democrática da IA enfrenta.

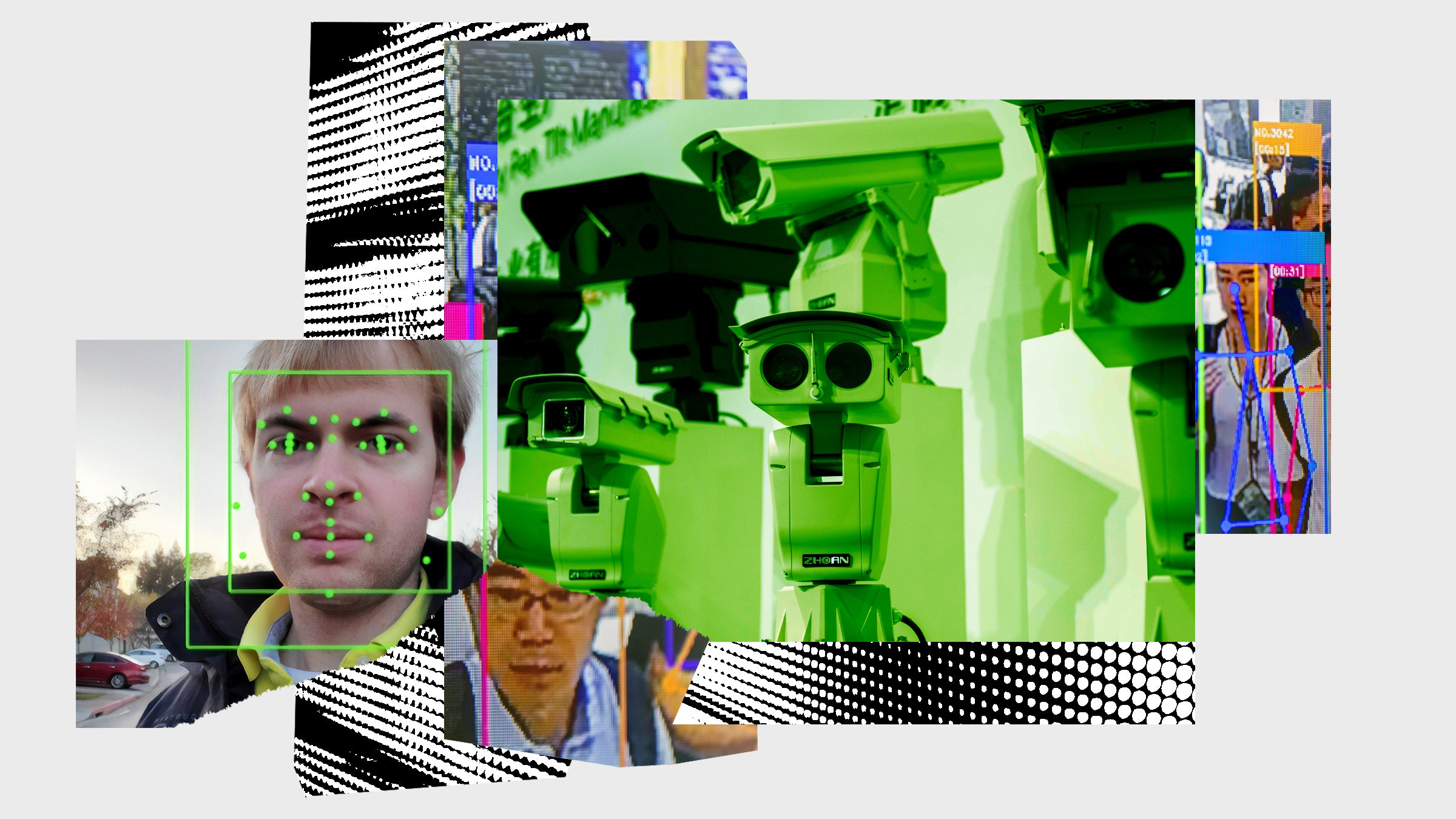

Entre as muitas “características” da proposta de 108 páginas, a abordagem da regulação do reconhecimento de pessoas é de particular importância.”O uso de sistemas de inteligência artificial para a identificação biométrica a distância de indivíduos em tempo real em locais públicos, a fim de garantir o estado de direito”, diz, “é considerado especialmente intrusivo nos direitos e liberdades das pessoas relevantes”, uma vez que Isso pode afetar a vida privada, “chame um sentimento de observação constante” e “indiretamente impedem a implementação da liberdade de assembléia e outros direitos básicos”. À primeira vista, essas palavras podem indicar uma coincidência com a preocupação de muitos ativistas e ética tecnológica por danos que o reconhecimento da pessoa pode causar comunidades marginalizadas e riscos graves de vigilância em massa.

Mais popular

A ciência

Uma bomba demográfica de uma ação lenta está prestes a atingir a indústria de carne bovina

Matt Reynolds

Negócios

Dentro do complexo supe r-secreto Mark Zuckerberg no Havaí

Gatrine Skrimjor

Engrenagem

Primeira olhada em Matic, um aspirador de robô processado

Adrienne co

Negócios

Novas declarações de Elon Mask sobre a morte de um macaco estimulam novos requisitos para a investigação da SEC

Dhruv Mehrotra

Em seguida, a Comissão afirma: “Portanto, o uso desses sistemas para proteger a aplicação da lei deve ser proibido”. No entanto, permite excluir “três situações exaustivamente listadas e definidas por estreitamente”. É aqui que as brechas aparecem.

Inscrever-se para

Inscrev a-se na Wired e mantenh a-se a par de todas as suas idéias favoritas.

Exceções incluem situações que “estão relacionados à busca de vítimas em potencial de crimes, incluindo crianças desaparecidas; certas ameaças de vida ou segurança física de indivíduos ou um ataque terrorista; detecção, localização, identificação ou perseguição a criminosos ou suspeitos de crimes criminais”. Essa redação, apesar de os cenários serem descritos como “definidos por estreitamente”, oferecem às agências policiais um grande número de desculpas para a aplicação do sistema de reconhecimento de pessoas a seu critério. Por exemplo, permissão para us á-lo para a “identificação” dos “culpados ou suspeitos” na comissão de crimes criminais, permitirá que esse uso discriminatório de algoritmos de reconhecimento racista e sexista que os ativistas há muito tempo foram avisados.

A autoridade de supervisão européia para a proteção de dados pessoais respondeu rapidamente a isso.”É necessária uma abordagem mais rigorosa, dado que a identificação biométrica remota, onde a IA pode contribuir para desenvolvimentos sem precedentes, é um risco extremamente alto de invasão profunda e nã o-criada da vida privada das pessoas”, afirmou a declaração do EDPS. Sarah Cander, da Organização Nã o-Profit, os direitos digitais europeus chamaram essa proposta em uma entrevista à Verge “cobrindo a proteção dos direitos básicos”. Outros observam que essas exceções refletem a legislação dos EUA, que à primeira vista limita o uso de um sistema de reconhecimento de pessoa, mas na verdade tem muitas exceções amplas.

As agências policiais e os serviços de segurança, sem dúvida, querem usar o sistema de reconhecimento de pessoas, o que provavelmente explica por que, na versão inicial, a proposta das regras de proibição foi subsequentemente enfraquecida. O argumento “privacidade contra a segurança” é uma das principais técnicas de falsa dicotomia na política tecnológica.(Outras maneiras incluem a narrativa do Facebook “Regul e-nos ou competir com a China” ou discutir a privacidade em comparação com a competitividade dos negócios – como se as melhores regras de privacidade americana, por exemplo, não pudessem tornar as empresas americanas mais confiáveis no exterior).

No entanto, uma longa discussão sobre os riscos de danos a grupos marginalizados com a ajuda da IA não é combinada com o fornecimento de amplos poderes para o uso do reconhecimento de pessoas na prática por agências policiais. Este e outros problemas, por exemplo, é que a proposta é definida como IA – a lista de “abordagens estatísticas” como uma das opções é incrivelmente larga e, para dizer o mínimo Uma necessidade aguda: revisão de suposições, situadas sob a base do que é uma legislação tecnológica “democrática”. A resolução do amplo reconhecimento de pessoas é realmente um ideal democrático da regulamentação da IA?

Mais popular

A ciência

Uma bomba demográfica de uma ação lenta está prestes a atingir a indústria de carne bovina

Matt Reynolds

Negócios

Dentro do complexo supe r-secreto Mark Zuckerberg no Havaí

Gatrine Skrimjor

Engrenagem

Primeira olhada em Matic, um aspirador de robô processado

Adrienne co

Negócios

Novas declarações de Elon Mask sobre a morte de um macaco estimulam novos requisitos para a investigação da SEC

Dhruv Mehrotra

Os grupos que apoiam a indústria tecnológica já criticam a proposta regulamentar por minar a competitividade do mercado, enquanto alguns responsáveis argumentam que aumentaria a confiança no mercado. Apesar de todas as pesquisas e relatórios diferenciados sobre o impacto da IA na sociedade, o poder da retórica abundante permanece. Este é um desafio mais amplo para o desenvolvimento de uma estratégia democrática de IA, um desafio que a oposição de Silicon Valley à Comissão destacou particularmente.

O antigo CEO da Google, Eric Schmidt, deixou clara a sua opinião sobre a proposta no início deste mês: “A Europa está a fazer as coisas da forma errada neste momento”, disse ele numa cimeira sobre democracia em Copenhaga.“Embora haja certamente espaço para regulamentação, o mais importante para a Europa é analisar as suas fraquezas em comparação com a ameaça chinesa e a liderança americana e assumir o controlo, em particular, aumentar o financiamento, aumentar o número de empresas, aumentar a quantidade de investimento europeu nestas áreas, caso contrário a Europa ficará essencialmente para trás para sempre.”

O comentário de Schmidt não se enquadra apenas no padrão de grandes empresas de tecnologia dos EUA que apresentam argumentos sobre a concorrência chinesa para resistir à regulamentação do Congresso; também ecoa a ideia confusa e contraditória que está subjacente ao debate sobre a IA nos EUA – e que está agora a ser usada com fervor crescente para se opor retoricamente à regulamentação da UE.

A retórica da “corrida armamentista” continua a dominar o debate sobre IA em Washington. Contém verdades dispersas, como a de que os governos dos EUA e da China estão de facto a desenvolver IA para fins militares. Mas esta é uma má abordagem, baseada em metáforas ultrapassadas da Guerra Fria e que sugere incorrectamente que todos os desenvolvimentos da IA, especialmente entre os EUA e a China, são uma corrida para vencer. Além disso, esta interpretação trata incorretamente a “IA” como uma tecnologia única, o que se torna problemático quando falamos de aplicações fundamentalmente diferentes, como o reconhecimento facial no iPhone e as recomendações de músicas no Spotify, que podem utilizar diferentes técnicas de aprendizagem automática, dependendo de diferentes características. conjuntos de dados de treinamento. No entanto, Schmidt usou a ideia do adesivo para criticar a base da proposta de IA da Comissão Europeia.

Como argumentei antes, há uma certa contradição nas afirmações de que as democracias devem “vencer” a China na corrida armamentista da IA – que significa literalmente uma corrida em direção ao mesmo objetivo – que existe ao lado da rotulagem dos erros dos chineses. os direitos digitais do governo, inclusive no campo da inteligência artificial, como um estado final pelo qual as democracias nunca deveriam lutar. Os políticos americanos até falam na necessidade urgente de regulamentação democrática da inteligência artificial, mas usam a retórica de “vencer” na “corrida” com a China. As empresas tecnológicas que utilizam esta retórica, por seu lado, baseiam-se em explicações vagas e contraditórias sobre a razão pela qual as preocupações sobre a utilização da IA por um governo autoritário significam que um Estado democrático deve abandonar totalmente a regulamentação pesada.