A Tiktok anunciou recentemente que seus usuários na União Europeia em breve poderão desativar o infame algoritmo de conteúdo. Isso é facilitado pela Lei da UE sobre serviços digitais (DSA), que faz parte dos esforços mais amplos da região para regular a IA e os serviços digitais de acordo com os direitos e valores humanos.

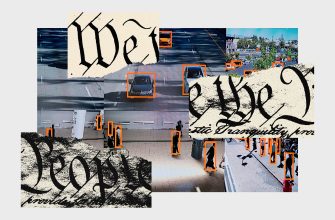

O algoritmo Tiktok estuda a interação dos usuários – quanto tempo eles olham para o que eles gostam quando compartilham o vídeo – para criar uma experiência individual e emocionante que pode formar seus estados mentais, preferências e comportamento sem sua completa consciência ou consentimento. A função de se recusar a ver é um grande passo para proteger a liberdade cognitiva, um direito fundamental à aut o-determinação de nosso cérebro e experiência mental. Em vez de se limitar a páginas algoritmizadas “para você” e transmissões diretas, os usuários poderão ver os vídeos de tendência em sua região e em seu próprio idioma, bem como a fita “amigos e assinantes”, na qual os autores que seguem o ordem cronológica. Assim, é dada prioridade ao conteúdo popular em sua região, e não ao conteúdo selecionado de acordo com o princípio da “adesão”. A lei também proíbe a publicidad e-alvo para usuários de 13 a 17 anos e oferece mais informações e oportunidades para relatar conteúdo ilegal ou prejudicial.

Opinion Wired

Sobre o site

Farahani Nita é o autor do livro “Batalha pelo seu cérebro: defendendo o direito de pensar em Frely na era da neurotecnologia (St. Martin’s Press 2023) e o professor de direito e filosofia Duke Robinson O. Everett.

Num mundo cada vez mais moldado pela inteligência artificial, Big Data e meios digitais, a necessidade urgente de proteger a liberdade cognitiva está a ganhar cada vez mais atenção. A proposta de Lei de Inteligência Artificial da UE oferece algumas salvaguardas contra a manipulação mental. A abordagem da UNESCO à IA dá prioridade aos direitos humanos, os compromissos voluntários da administração Biden por parte das empresas de IA visam combater o engano e a fraude, e a Organização para a Cooperação e Desenvolvimento Económico incluiu a liberdade cognitiva nos seus princípios para a gestão responsável das tecnologias emergentes. No entanto, embora essas leis e propostas registem progressos, muitas vezes centram-se em aspectos isolados do problema, como a privacidade desde a concepção ou a minimização de dados, em vez de uma abordagem clara e abrangente para proteger a nossa capacidade de pensar livremente. Sem quadros jurídicos sólidos em vigor em todo o mundo, os desenvolvedores e fornecedores destas tecnologias podem evitar responsabilidades. É por isso que mudanças meramente graduais não serão suficientes. Os legisladores e as empresas precisam urgentemente de reformar os modelos de negócio que sustentam o ecossistema tecnológico.

Um plano bem estruturado requer uma combinação de regulamentações, incentivos e mudanças comerciais que se concentrem na liberdade cognitiva. As normas regulamentares devem reger os modelos de envolvimento dos utilizadores, a partilha de informações e a privacidade dos dados. É necessário fornecer garantias legais confiáveis contra a interferência na vida privada e a manipulação da psique. As empresas devem ser transparentes sobre como funcionam os algoritmos que implementam e devem avaliar, divulgar e tomar salvaguardas contra influências indevidas.

Como os princípios da responsabilidade social corporativa, as empresas também devem ser legalmente obrigadas a avaliar suas tecnologias quanto à sua influência na liberdade cognitiva, garantindo a transparência dos algoritmos, o uso de dados, métodos de moderação do conteúdo e a formação de habilidades cognitivas. Os efeitos na avaliação de impacto já são parte integrante das propostas legislativas em todo o mundo, incluindo a lei da UE sobre serviços digitais, a lei sobre relatórios de algoritmo e a lei americana sobre privacidade e proteção de dados, bem como mecanismos voluntários, como o risco de 2023 Lei de Gerenciamento. Instituto Nacional de Padrões e Tecnologias dos Estados Unidos. A ferramenta para avaliar o impacto na liberdade cognitiva medirá a influência da IA na aut o-determinação, confidencialidade mental, liberdade de pensar e tomar decisões, prestar atenção especial à transparência, prática de trabalhar com dados e manipular a consciência. Os dados necessários incluirão uma descrição detalhada de algoritmos, fontes e coleta de dados, bem como evidência da influência da tecnologia no conhecimento do usuário.

Incentivos e financiamento fiscais também podem contribuir para a inovação em práticas e produtos comerciais para fortalecer a liberdade cognitiva. Os principais pesquisadores do campo da ética enfatizam que, para neutralizar numerosos riscos que carregam grandes modelos de linguagem, é necessária uma cultura organizacional, o que coloca a segurança na vanguarda. Os governos podem incentivar isso oferecendo benefícios fiscais e oportunidades de financiamento, como as incluídas na lei proposta sobre os relatórios e transparência das plataformas, empresas que cooperam ativamente com instituições educacionais para criar aut o-determinação e desenvolvimento de habilidades de pensamento crítico. Os incentivos fiscais também podem apoiar pesquisas e inovações no campo de instrumentos e métodos para identificar fraudes dos modelos de IA.

As empresas tecnológicas também devem introduzir princípios de design que incorporem a liberdade cognitiva. Oportunidades como configurações ajustáveis de Tiktok ou controle mais amplo sobre os dispositivos Apple são etapas na direção certa. Outras funções que permitem a aut o-determinação – incluindo a marcação do conteúdo de “ícones” que o definem como criado por uma pessoa ou máquina, ou uma solicitação aos usuários para tratar criticamente o artigo antes de coloc á-lo novamente, devem se tornar a norma em todos os digitais plataformas.

Mudar a política do Tiktok na Europa é uma vitória, mas esse não é o fim. Precisamos urgentemente atualizar o conjunto de regras digitais, introduzindo novas leis, regras e incentivos que protegem os direitos dos usuários e forçam as plataformas a serem responsáveis. Não vamos deixar o controle sobre nossa mente apenas para empresas tecnológicas; Chegou a hora de ações globais destinadas a garantir a prioridade da liberdade cognitiva na era digital.

A opinião da Wired publica artigos de autores de terceiros, representando uma ampla gama de pontos de vista. Leia outras opiniões aqui. Publique sua opinião no site idéias@wired. com.